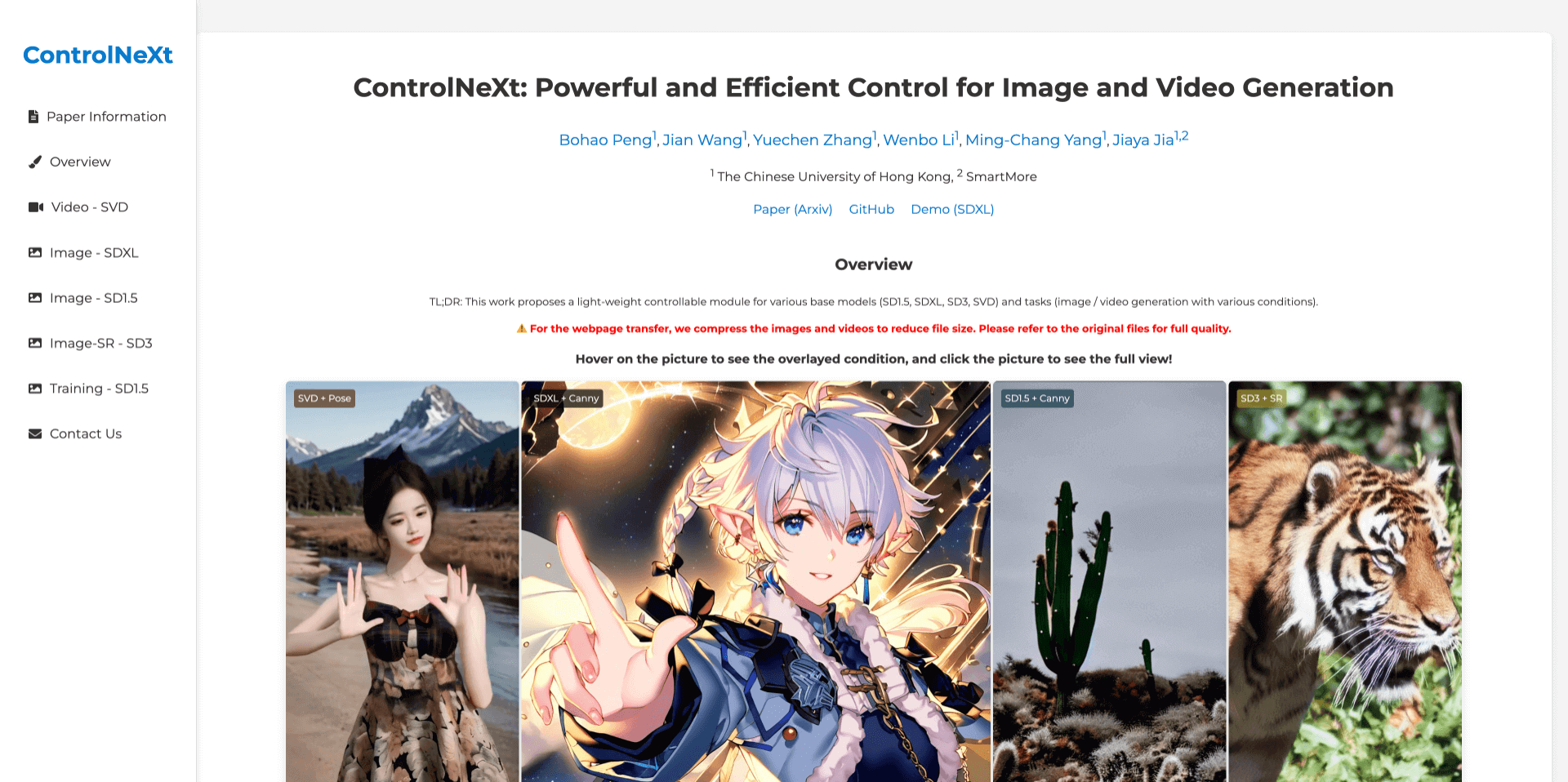

ControlNeXt是什么?

ControlNeXt 是由賈佳亞團隊開發的圖像和視頻生成控制工具,該工具在生成速度、精準控制和用戶友好性方面有顯著提升,兼容多款 Stable Diffusion 模型,如 SD1.5、SDXL、SD3 和 SVD,實現了即插即用的便捷體驗。ControlNeXt 支持多種條件控制,包括 Canny 邊緣、掩模、景深、姿勢等,能夠生成高質量的圖像和視頻,且支持超分辨率和人體姿勢動作的精準控制。

ControlNeXt的功能特性

- 廣泛兼容性: ControlNeXt 兼容多種 Stable Diffusion 模型,包括 SD1.5、SDXL、SD3 和 SVD,適用于不同的圖像和視頻生成任務。

- 多種條件控制: 該工具支持多種條件控制,如 Canny 邊緣檢測、掩模、景深、姿勢指導等,能夠根據具體需求生成高質量的圖像和視頻。

- 超分辨率支持: ControlNeXt 提供圖像超分辨率功能,提升生成圖像的清晰度和細節表現。

- 精確的姿勢控制: 工具支持對人體姿勢和動作的精準控制,適用于需要精細人物動作調整的任務。

- 即插即用: 設計簡便,ControlNeXt 可以輕松集成到現有的工作流程中,無需復雜的配置。

ControlNeXt的使用場景

- 創意設計與藝術創作: 藝術家和設計師可以利用 ControlNeXt 根據特定的條件(如 Canny 邊緣檢測或姿勢調整)生成和編輯圖像,以實現他們的創意愿景。

- 視頻制作: ControlNeXt 能夠基于姿勢序列和初始幀生成視頻內容,非常適合用于動畫制作和視頻特效的生成。

- 圖像增強: 攝影師和內容創作者可以利用 ControlNeXt 的超分辨率功能來提升圖像質量,適用于高端攝影和數字內容制作。

- 人物動畫制作: ControlNeXt 的精確姿勢控制功能非常適合用于角色動畫制作,特別是在需要精細人物動作的場景中。

- 研究與開發: 從事 AI 驅動的圖像和視頻生成研究的科研人員可以利用 ControlNeXt 的高級控制機制,探索生成建模和視覺內容創作的新可能性。

如何使用ControlNeXt?

ControlNeXt開放了源代碼,前往GitHub按照使用教程即可本地部署使用。

- ControlNeXt項目主頁:https://pbihao.github.io/projects/controlnext/index.html

- ControlNeXt GitHub源代碼:https://github.com/dvlab-research/ControlNeXt

- ControlNeXt論文地址:https://arxiv.org/abs/2408.06070

?版權聲明:如無特殊說明,本站所有內容均為AIHub.cn原創發布和所有。任何個人或組織,在未征得本站同意時,禁止復制、盜用、采集、發布本站內容到任何網站、書籍等各類媒體平臺。否則,我站將依法保留追究相關法律責任的權利。